Wer effizient ist, gewinnt – wer sich anstrengt, hat schon verloren. Also lassen wir KI für uns arbeiten. Schnell, bequem, fehleranfällig. Aber was passiert, wenn wir das Denken zu oft delegieren? Kolja Wohlleben geht dieser Frage nach – und zeigt, warum uns Effizienz zwar oft weiterbringt, aber auch träge machen kann.

Gute Chefs belohnen harte Arbeit nicht.

In gut geführten Organisationen zählt das Ergebnis mehr als die Energie, die wir dafür aufgewandt haben. Die Frage ist nicht: „Wer hat sich am meisten angestrengt?“ sondern: „Wer liefert das beste Ergebnis möglichst schnell?“

Der Weg zum Erfolg ist der des geringsten Widerstands

Wir setzen Zielvereinbarungen – keine Anstrengungsvereinbarungen. Jemanden „ergebnisorientiert“ zu nennen, ist ein Lob, „Er hat sich stets bemüht“ ein vernichtendes Urteil. Und das ist gut so! Im besten Fall handeln wir deswegen effizient, klug und zielgerichtet, statt sehr hart an den falschen Dingen zu arbeiten.

Gleichzeitig neigen wir ohnehin dazu, Anstrengung zu vermeiden: Unnötig Energie zu verbrauchen ist keine evolutionäre Erfolgsstrategie. Deshalb lassen wir Computer für uns rechnen, nutzen Heuristiken und halten einfache Erklärungen für korrekter.

Ohne große Anstrengung gute Ergebnisse zu liefern ist also meist die optimale Strategie, die aber gleichzeitig auf Kosten unserer kognitiven Fitness geht.

Wenn wir Anstrengung vermeiden, tauschen wir Kompetenz in Einzeltätigkeiten gegen Effizienz in unserem Job insgesamt ein: Die Buchhalterin, die darauf bestünde, alle Jahresabschlüsse mit Stift und Papier auszurechnen, wäre vermutlich besser im Kopfrechnen, aber eben auch bald arbeitslos.

Lesen und Schreiben: Die originale „digitale Demenz“

Wenn neue Technologien uns Anstrengung abnehmen, ruft das immer die gleiche Sorge hervor: Werden wir jetzt dümmer? 2010 fragte die New York Times zum Beispiel, ob Handys schlecht für unser Langzeitgedächtnis sind, weil wir uns keine Telefonnummern mehr merken müssen (Fragwürdige Antwort des Autors: Wahrscheinlich nicht, weil wir dafür jetzt ja mehr Passwörter behalten müssen!).

Der Klassiker des Genres ist Sokrates, der seinen Analphabetismus damit verteidigte, dass die Schrift unser Gedächtnis schädige: “Diese Erfindung wird der Lernenden Seelen vielmehr Vergessenheit einflößen aus Vernachlässigung des Gedächtnisses.”

Bislang war die Antwort auf die Frage, ob wir durch neue Technologien verdummen oder sonstwie zurückentwickeln, meistens: Nein.

Technologie ermöglicht Komplexität

Einige Fähigkeiten werden weniger gebraucht, dafür verlagern wir uns eben auf andere Dinge, die oft viel anspruchsvoller sind. Im Mathematikunterricht erlauben wir Schülern irgendwann den Einsatz von Taschenrechnern, damit sie sich mit Analysis oder Algebra beschäftigen können.

Tatsächlich ist es eher plausibel, dass Menschen durch technischen Fortschritt und erhöhte Komplexität ihrer Umgebungen bis vor wenigen Jahren immer intelligenter geworden sind.

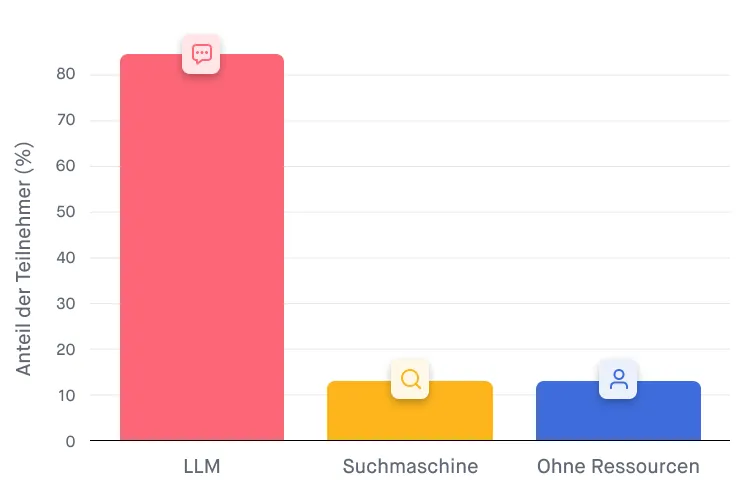

Aktuell hören wir aber wieder: Technologie – dieses Mal natürlich KI – führt zu Verdummung. So zeigt eine virale Studie des MIT angeblich, dass die Benutzung von LLMs zu „kognitivem Verfall“ („Cognitive Atrophy“) führt.

Your Brain on ChatGPT

Für die Studie (Your Brain on ChatGPT) wurden Teilnehmer gebeten, Aufsätze zu Themen wie „Ist eine perfekte Gesellschaft möglich?“ zu schreiben. Eine Gruppe Teilnehmer durfte dafür ChatGPT nutzen. Und lagerte ihre Denkleistung, wenig überraschend, entsprechend aus: Ihre Gehirne waren deutlich weniger aktiv und sie konnten bereits wenige Stunden nach Abgabe kaum noch aus ihren „eigenen“ Texten zitieren.

Anstrengung ist enorm hilfreich, um neue Verknüpfungen im Gehirn aufzubauen. Dass die Gruppe, die sich in Sekunden komplette Aufsätze schreiben lassen konnte, auch am wenigsten von der ganzen Übung behielt, überrascht also nicht.

Die meisten Arbeitnehmer sind aber selten in der Situation, Aufsätze über die Möglichkeit einer perfekten Gesellschaft zu schreiben. Was zeigt uns diese Studie also, außer, dass, wer weniger von einem Text selber schreibt, auch weniger davon weiß?

Vielleicht erst die gute Nachricht: Diese Studie zeigt nicht, dass „ChatGPT Nutzung dümmer macht“, wie einige Artikel – die in ihrer Vorhersehbarkeit wiederum auch stark an LLM-Texte erinnern – bereits suggerieren.

In den deutlichen Worten der Autorinnen der Studie (die ironischerweise nicht von jedem gelesen wurden):

„Machen LLMs uns dümmer? Nein! Bitte nutzen Sie keine Wörter wie ‚dumm‘, ‚Schaden‘, ‚Passivität‘, ‚Verfall‘ (...) und so weiter. Damit erweisen Sie dieser Arbeit einen Bärendienst, vor allem, wenn Sie ein Journalist sind, der darüber berichtet, denn wir haben dieses Vokabular in dem Paper nicht verwendet.“

Was die Studie vor allem zeigt, ist, dass wir unsere Gehirne weniger nutzen, wenn wir sie weniger nutzen müssen – genau so, wie man es von ergebnisorientierten Aufwandvermeidern erwarten würde.

Aufgaben abgeben, Verständnis aufgeben

Die weniger gute Nachricht ist, dass das eben nicht nur für Aufsätze und Hausarbeiten gilt: Bei Aufgaben wie Marktanalyse, Vertragsprüfung oder Datenauswertung sind Anreize und Versuchung vielleicht erst recht groß, die Abkürzung zu nehmen.

Und oft wird genau das erfolgreich sein: Ob Marktanalyse, Vertragsprüfung oder Datenauswertung – alles ist häufig schnell und zumindest oberflächlich gut erledigt.

Das führt gelegentlich auch dazu, dass wir überzeugende Dokumente bekommen, die auf frei erfundenen Informationen beruhen.

Vor allem aber sind Marktanalysen, Vertragsprüfungen und Datenauswertungen nicht einfach das Dokument, das am Ende herauskommt. Es sind auch Prozesse, die uns befähigen, in Zukunft klüger zu handeln.

Vereinfacht gesagt: Diese Aufgaben einer KI zu überantworten, führt dazu, dass wir zwar eine Marktanalyse haben, aber nicht dazu, dass wir den Markt verstehen.

Es ist nicht offensichtlich, dass wir in Zukunft immer ausreichend Anreize und Zeit bekommen, den Markt auch wirklich zu verstehen. Sicherlich ist tiefer gehendes Verständnis für sich genommen immer ein Vorteil – aber einer, der durch die Langsamkeit menschlicher Anstrengung erkauft werden muss.

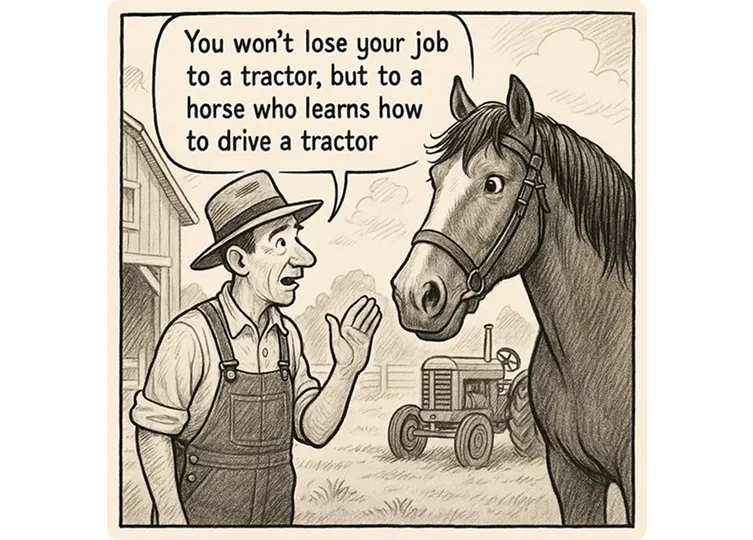

Ein bekannter Allgemeinplatz zu künstlicher Intelligenz ist, dass wir unsere Jobs nicht an KI verlieren, sondern an jemanden, der KI besser nutzt als wir. Aber „besser“ heißt aus Unternehmensperspektive eben oft nicht, dass im Arbeitsprozess Verständnis aufgebaut wurde, sondern, dass schnell ein akzeptables Endergebnis vorliegt.

Der Mitarbeiter, der einen KI-generierten Bericht weitgehend ungeprüft an einen unkritischen Chef weiterleitet, trifft damit im Einzelfall vielleicht die „bessere“ Entscheidung.

Wissen ist das, was vom Denken übrig bleibt

Macht KI uns also wirklich dumm? Das ist sicher weiterhin zu pauschal – aber immerhin plausibler als bei Taschenrechnern oder der Schrift. Denn die Anreizlogik von Organisationen und unsere eigene Bequemlichkeit könnten durchaus dazu führen, dass wir langsam unserem Verständnis für komplexe Zusammenhänge schaden.

Aber: Verständnis für Komplexität, kritisches Denken und Erfahrungswissen sind ebenfalls Wettbewerbsvorteile. Und diese entwickeln wir nur, wenn wir neue Technologie klug nutzen und damit „kognitiven Verfall“ vermeiden.

Wissen ist das, was vom Denken übrig bleibt – und nur wenn wir unser Denken nicht abgeben, bleibt auch weiterhin Wissen zurück.

{{blog-lp-link-shorts-ai-perspectives-de="/custom-rich-text"}}